Millones en publicidad nos convencieron de que el agua embotellada era más sana. Hasta que llegaron los microplásticos

En muchas ocasiones podemos asociar el agua embotellada como una opción de mayor calidad para poder hidratarnos por encima del agua del grifo. Pero la realidad es que los últimos análisis científicos apuntan a que el agua embotellada es una fuente directa de exposición a nano y microplásticos (NMPs).

Esto es algo que supone que los consumidores habituales de agua embotellada pueda estar ingiriendo hasta 90.000 partículas de plástico adicionales al año en comparación con quienes beben agua del grifo. Algo que rompe con la idea que podemos llegar a todos de que el agua embotellada es mucho más sana como siempre nos han intentado vender.

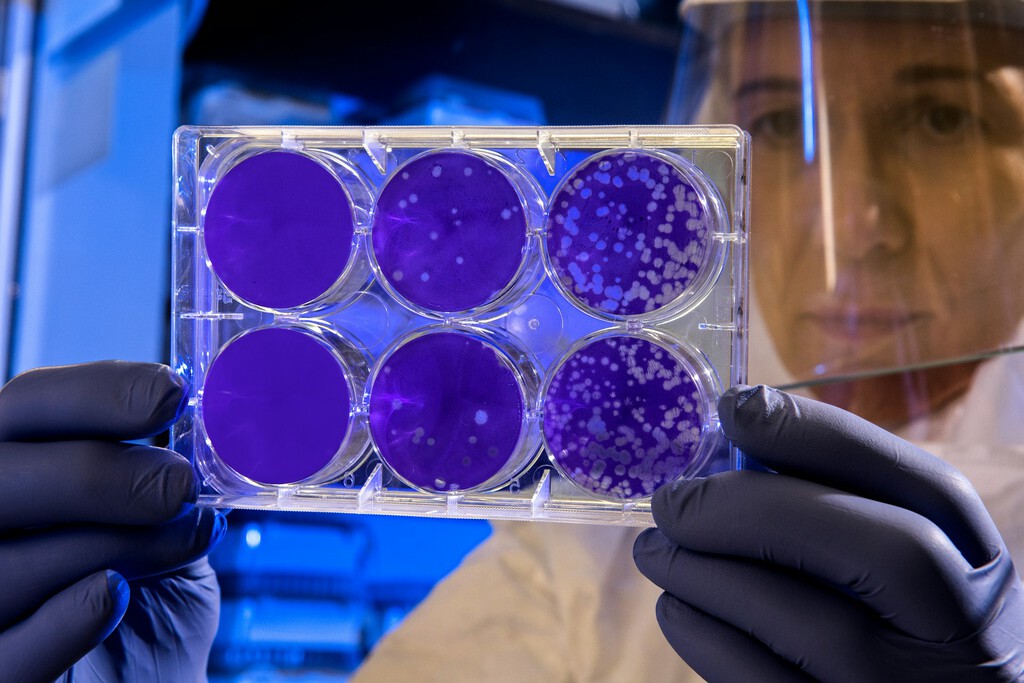

El enemigo invisible. El estudio, publicado en la revista Journal of Hazardous Materials define los microplásticos como partículas de entre 1 micrómetro y 5 mm y los nanoplásticos como aquellos inferiores a 1 micrómetro. Unas partículas muy pequeñas a fin de cuentas que se van desprendiendo de las botellas de plástico durante todo su ciclo de vida.

Cómo se liberan. Según el estudio, las partículas se liberan no solo por la degradación natural del plástico, sino también por estresores físicos y ambientales cotidianos. Por ejemplo, el simple acto de abrir y cerrar el tapón o apretar la botella para beber genera una fricción que termina con el desprendimiento de partículas en el agua.

Otro caso muy común es dejar la botella de agua al sol durante un cierto tiempo. Aquí se están desprendiendo muchas partículas de plástico porque se está aumentando la degradación del envase. Pero en el caso contrario, en la congelación, también tenemos este mismo problema porque también se ha demostrado que es un factor que incrementa la contaminación por microplásticos.

El tamaño importa. Una vez que se ingieren estas partículas, su efecto va a depender del tamaño que tenga. De manera general, cuando más pequeña sea más preocupante es para nuestro organismo, puesto que más fácilmente va a poder atravesar las barreras biológicas.

Si hablamos de partículas mayores de 150 micrómetros la verdad es que podemos estar tranquilos porque directamente va a pasar por el tubo digestivo hasta las heces. Pero en el caso de que sean menores de 150 micrómetros, sí que van a poder atravesar la cavidad intestinal y entrar en el sistema linfático y circulatorio, pudiendo llegar a los órganos con partículas de menos de 20 micrómetros.

Pero el verdadero peligro está en las partículas de menos de 100 nanómetros que se consideran nanoplásticos. En este caso, las partículas son suficientes pequeñas como para alcanzar todos los órganos, incluyendo la capacidad de cruzar barreras tan críticas como la barrera hematoencefálica y la placenta.

Los peligros. La exposición continua a nano y microplásticos está vinculada a una serie de problemas de salud crónicos. No se trata de una toxicidad aguda, sino de un daño acumulativo a largo plazo. Entre los principales riesgos que se han identificado se encuentran las enfermedades respiratorias, los productos reproductivos, la disrupción del sistema inmune o el aumento del estrés oxidativo.

El reto. Uno de los grandes desafíos para los investigadores está en la falta de métodos para analizar estos plásticos que estén estandarizados. Ahora mismo se pueden encontrar diferentes pruebas, pero varían en sensibilidad y precisión, lo que dificulta llegar a un criterio común entre los diferentes estudios con el objetivo de tener una imagen general del gran problema que tenemos delante.

Ahora mismo, algunas técnicas pueden detectar partículas muy pequeñas, pero no su composición, mientras que otras hacen lo contrario, siendo una limitación muy importante. Pero a pesar de estas, algunos estudios ya apuntan a diferencias significativas entre las marcas de agua que encontramos en el mercado. Por ejemplo, una investigación citada en el informe encontró que Nestle Pure Life y Bisleri presentaban algunas de las concentraciones medias más altas de partículas de microplásticos.

Regulación. Esta falta de estandarización en los estudios ha contribuido a que haya un gran "vacío legislativo" en nuestra sociedad. Y es que mientras se ha legislado sobre las bolsas de plástico, las pajitas o los cubiertos de un solo uso, las botellas de agua han quedado en gran medida fuera del foco regulatorio.

De esta manera, el autor del estudio apunta a que el consumo de agua en botellas de plástico debería hacerse en situaciones de emergencia, pero no como una práctica diaria por el alto consumo de microplásticos que vamos a terminar ingiriendo y que generaría un problema a largo plazo.

Y es que ya hemos sido testigos precisamente de cómo han aparecido microplásticos en testículos humanos, la leche materna, la sangre, restos arqueológicos o también en los alimentos que ingerimos, como las verduras que consumimos. Es por ello que a la larga se va a tener que ver concretamente el impacto que tendrá su consumo de manera prolongada a través de diferentes vías, y no solo el agua embotellada.

Imágenes | Jonathan Cooper

En Xataka | De causar diarreas a fabricar plásticos biodegradables: la bacteria E. coli tiene un nuevo trabajo en Japón

-

La noticia

Millones en publicidad nos convencieron de que el agua embotellada era más sana. Hasta que llegaron los microplásticos

fue publicada originalmente en

Xataka

por

José A. Lizana

.