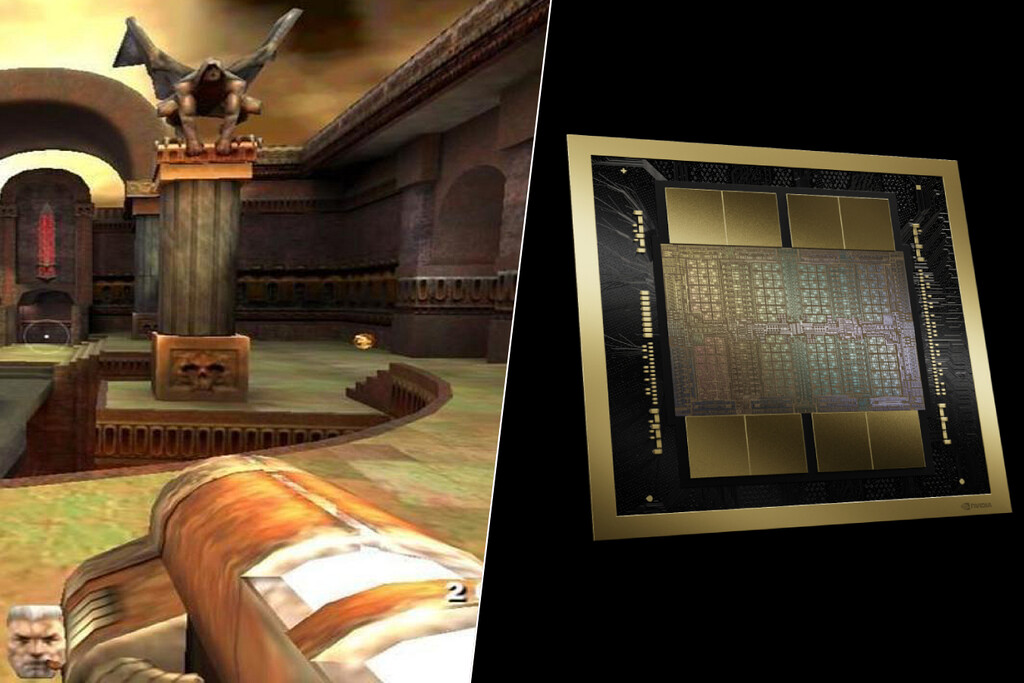

Hace un cuarto de siglo un estudiante unió 32 tarjetas gráficas GeForce para jugar a Quake III. De allí salió CUDA

En el año 2000 Ian Buck quiso hacer algo que parecía imposible: jugar a Quake III en resolución 8K. El joven Buck estaba estudiando informática en Stanford y especializándose en gráficos computerizados, y entonces se le ocurrió una idea loca: unir 32 tarjetas gráficas GeForce y renderizar Quake III en ocho proyectores colocados estratégicamente.

"Aquello", explicó años más tarde, "era precioso".

Buck contó esa historia en 'The Thining Machine', el ensayo publicado por Stephen Witt en 2025 que recorre la historia de NVIDIA. Y por supuesto una de las partes fundamentales de esa historia es el origen de CUDA, la arquitectura que los desarrolladores de IA han convertido en una joya y que ha permitido impulsar a la empresa y convertirla en la más importante del mundo por capitalización bursátil.

Y todo empezó con Quake III.

La GPU como supercomputadora doméstica

Aquello, por supuesto, solo fue un experimento divertido, pero para Buck fue una revelación, porque allí descubrió que quizás las chips gráficos especializados (GPUs, por Graphic Processing Units) podían hacer algo más que dibujar triángulos y renderizar fotogramas de Quake.

En 2006 la GeForce 8800 GTS (y su versión superior, la GTX) iniciaron la era CUDA.

Para averiguarlo se adentró en los aspectos técnicos de los procesadores gráficos de NVIDIA y comenzó a investigar sobre sus posibilidades como parte de su doctorado de Stanford. Reunió a un pequeño grupo de investigadores y, con una subvención del DARPA (Defense Advanced Research Projects Agency) comenzó a trabajar en un lenguaje de programación d ecódigo abierto al que llamó Brook.

Ese lenguaje permitía algo asombroso: lograr que las tarjetas gráficas se convirtieran en supercomputadoras domésticas. Buck demostró que las GPUs, teóricamente dedicadas a trabajar con gráficos, podían resolver problemas de propósito general, y hacerlo además aprovechando el paralelismo que ofrecían esos chips.

Así, mientras una parte del chip iluminaba el triángulo A, otro ya estaba rasterizando el triángulo B y otro escribiendo el triángulo C en memoria. No era exactamente lo mismo que el paralelismo de datos actual, pero aun así ofrecía una potencia de cálculo asombrosa, muy superior a cualquier CPU de la época.

Aquel lenguaje especializado acabó convirtiéndose en un paper llamado 'Brook for GPUs: stream computing on graphics hardware'. De repente la computación paralela estaba disponible para cualquiera, y aunque aquel proyecto apenas tuvo cobertura pública, se convirtió en algo que una persona tuvo claro que era importante.

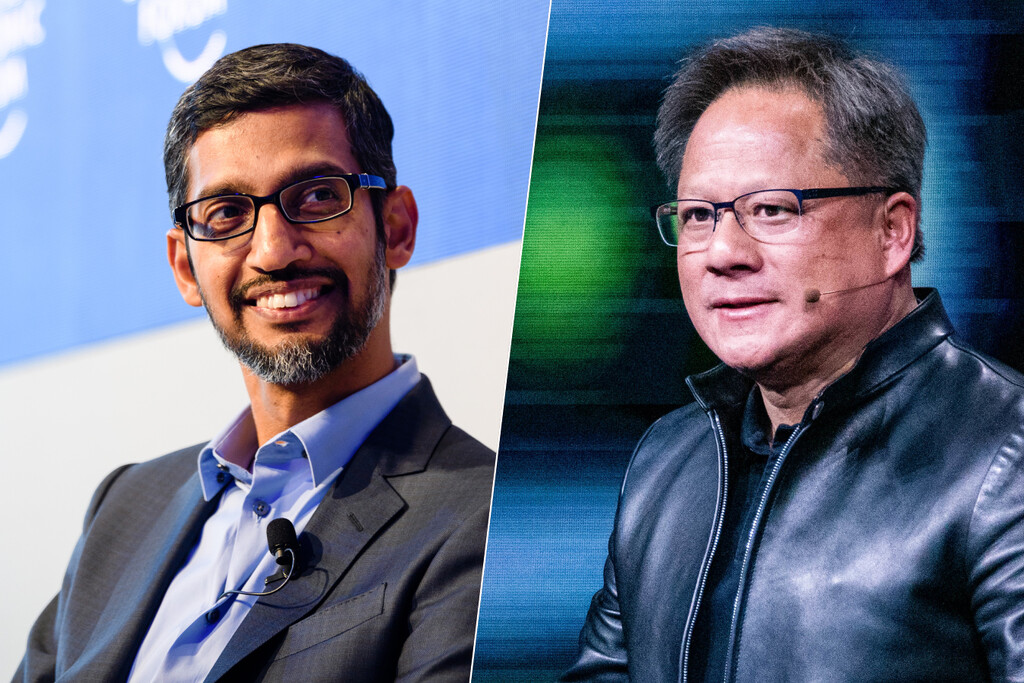

Esa persona era Jensen Huang.

Poco después de publicar ese estudio, el fundador de NVIDIA se reunió con Buck y lo fichó en el acto. Se dio cuenta de que aquella capacidad de los procesadores gráficos podía y debía explotarse, y comenzó a dedicar más y más recursos a ello.

Nace CUDA

Cuando en 2005 Silicon Graphics se hundió —por culpa de una NVIDIA que estaba intratable en estaciones de trabajo— muchos de sus empleados acabaron trabajando para la compañía. 1.200 de ellos de hecho fueron directos a la división de I+D, y uno de los grandes proyectos de esa división era precisamente el de sacar adelante esa capacidad de estas tarjetas.

John Nickolls / Ian Buck.

Nada más llegar a NVIDIA, Ian Buck comenzó a trabajar con John Nickolls, que antes de trabajar para la firma había intentando —sin éxito— adelantarse al futuro con su apuesta por la computación paralela. Aquel intento fracasó, pero junto con Buck y algunos ingenieros más puso en marcha un proyecto al que NVIDIA prefirió dar un nombre algo confuso. Lo llamó Compute Unified Domain Architecture.

Había nacido CUDA.

El trabajo en CUDA avanzó rápidamente y NVIDIA lanzó la primera versión de esta tecnología en noviembre de 2006. Aquel software era gratuito, pero solo era compatible con hardware de NVIDIA. Y como suele suceder con muchas revoluciones, CUDA tardó en cuajar.

En 2007 la plataforma software se descargó 13.000 veces: los cientos de millones de usuarios de gráficas de NVIDIA solo las querían para jugar, y así siguió siendo durante mucho tiempo. Programar para sacar provecho de CUDA era difícil, y esos primeros tiempos fueron muy difíciles para este proyecto, que consumía mucho talento y finanzas en NVIDIA sin que se vieran beneficios reales.

De hecho, los primeros usos de CUDA no tuvieron nada que ver con inteligencia artificial porque apenas se hablaba de inteligencia artificial en aquel momento. Quienes aprovecharon esta tecnología eran departamentos científicos, y solo años después se perfilaría la revolución que podría provocar esta tecnología.

Un éxito tardío (pero merecido)

De hecho, el propio Buck lo apuntó en una entrevista en 2012 con Tom's Hardware en 2012. Cuando el entrevistador le preguntó qué futuros usos le veía a la tecnología GPGPU que ofrecía CUDA en el futuro, él dio algunos ejemplos.

Habló de empresas que estaban usando CUDA para diseñar ropa o coches de última generación, pero añadió algo importante:

"En el futuro, seguiremos viendo oportunidades en los medios personales, como la clasificación y búsqueda de fotos basadas en el contenido de la imagen, es decir, rostros, ubicación, etc., que es una operación que requiere una gran capacidad de cálculo".

Aquí Buck sabía de lo que hablaba, aunque no se imaginaba que aquello sí sería el principio de la verdadera revolución de CUDA. En 2012 dos jóvenes estudiantes de doctorado llamados Alex Krizhevsky e Ilya Sutskever desarrollaron un proyecto bajo la tutela de su supervisor, Geoffrey Hinton.

Aquel proyecto no era otro que AlexNet, el software que permitía clasificar imágenes de forma automática y que hasta entonces había sido un reto inútil por el coste de la computación que requería. Fue entonces cuando estos académicos entrenaron una red neuronal con tarjetas gráficas de NVIDIA y con el software CUDA.

De repente la IA y CUDA comenzaban a tener sentido.

El resto, como suele decirse, es historia.

-

La noticia

Hace un cuarto de siglo un estudiante unió 32 tarjetas gráficas GeForce para jugar a Quake III. De allí salió CUDA

fue publicada originalmente en

Xataka

por

Javier Pastor

.