Airbus está a punto de cerrar un nuevo pedido masivo en China, según SCMP. El momento no puede ser peor para Boeing

Airbus se prepara para reforzar su presencia en uno de los mercados más estratégicos del planeta: China. South China Morning Post dice que el fabricante europeo está a las puertas de firmar un nuevo acuerdo con las autoridades chinas que incluiría entre 100 y 200 nuevos aviones. La firma podría llegar este mismo mes, pero lo que realmente llama la atención no es la magnitud del pedido, sino el momento en el que se produce.

La operación coincidiría con la cumbre entre la Unión Europea y China de los días 24 y 25 de julio, según ha adelantado Politico. Un encuentro diplomático de alto nivel que busca rebajar las tensiones comerciales, redefinir las relaciones entre Bruselas y Pekín, y gestionar un clima cada vez más tenso en sus vínculos con Washington. Que Airbus logre cerrar un contrato de esta envergadura justo en ese contexto es algo que no pasa desapercibido.

¿Un nuevo orden en los cielos chinos?

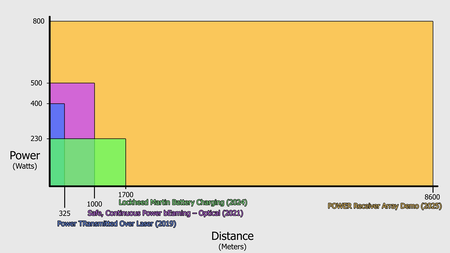

China lleva años sin cerrar grandes acuerdos con Boeing. El último pedido relevante se remonta a 2017, y desde entonces el fabricante estadounidense ha ido perdiendo terreno en uno de los mercados más dinámicos de la aviación comercial. El motivo no es solo comercial: el enfriamiento de las relaciones entre Washington y Pekín, la guerra arancelaria y las dudas regulatorias parecen estar inclinando la balanza hacia el lado europeo. Como señala el medio hongkonés, Airbus ha ido ganando peso como proveedor principal.

El tiempo también juega a favor de Airbus. Muchas aerolíneas chinas están lidiando con flotas envejecidas, compuestas en su mayoría por aviones de Boeing adquiridos hace más de una década. En casos como Shandong Airlines o China United Airlines, el grueso de los aparatos supera los diez años de servicio. A medida que los aviones acumulan horas de vuelo, en líneas generales, su mantenimiento se vuelve más costoso, su eficiencia operativa disminuye y aumentan los periodos de inactividad.

A simple vista, podría parecer que una aerolínea puede compensar la situación combinando fabricantes. Sin embargo, operar una flota mixta implica complejidad logística y costes elevados. Un análisis de AirInsight concluyó que los gastos derivados de gestionar dos tipos de flota —repuestos, formación, documentación, ratio de tripulación— se amortizan en apenas 12–15 meses y luego favorecen un ahorro significativo en la vida útil de la flota.

La estandarización —optar por un solo proveedor como Airbus o Boeing— reduce costes operativos, simplifica la formación del personal y agiliza la gestión de repuestos. En contraposición, cambiar de fabricante obliga a reorganizar cadenas de suministro, formar a pilotos y técnicos en nuevos modelos y adaptar las infraestructuras de mantenimiento. Esto último implica desde actualizar los hangares y talleres a los requerimientos físicos del nuevo avión, hasta adquirir herramientas específicas. Para muchas aerolíneas, esa barrera de entrada parece explicar por qué siguen dependiendo de flotas Boeing incluso cuando Airbus gana terreno.

China también está apostando por desarrollar su propia alternativa. Las tres grandes aerolíneas estatales —Air China, China Eastern y China Southern— ya han comprometido la compra de más de 100 unidades del Comac C919, el avión de pasajeros desarrollado por la industria aeronáutica china. El respaldo político es evidente, pero también lo son sus límites: la producción es todavía reducida, las certificaciones internacionales están en fase inicial y la red de soporte técnico no tiene la madurez ni la escala de Airbus o Boeing. Por ahora, el C919 es una promesa a medio plazo, pero no una solución inmediata para cubrir la enorme demanda del mercado interno.

Pese a todo, Boeing no está totalmente fuera del juego. En abril de 2025, varios 737 MAX preparados para aerolíneas chinas regresaron a Estados Unidos después de que Beijing ordenara suspender las entregas, como parte de su respuesta a los nuevos aranceles contra productos estadounidenses. Aunque esta medida apunta a un impulso protector de la industria nacional y la estrategia geopolítica, Boeing aún podría recuperar terreno si se reduce la tensión comercial y se reanuda el acceso al mercado chino. Pero, de momento, Airbus se perfila como favorito.

Airbus conoce bien el potencial del mercado chino. Según sus propias previsiones, el país necesitará más de 9.500 nuevos aviones comerciales en los próximos 20 años. Boeing maneja una cifra similar: alrededor de 8.830 a 9.740 unidades, dependiendo del escenario económico y regulatorio. En cualquiera de los casos, estamos hablando de una demanda gigantesca. Y en este momento, con los pedidos a Boeing congelados y Comac aun consolidándose, Airbus tiene una ventaja clara. Si el nuevo contrato se confirma, no será un caso aislado: será el reflejo de una tendencia que puede marcar el reparto de poder en la aviación comercial durante las próximas décadas.

Imágenes | Fasyah Halim | Takashi Miyazaki

-

La noticia

Airbus está a punto de cerrar un nuevo pedido masivo en China, según SCMP. El momento no puede ser peor para Boeing

fue publicada originalmente en

Xataka

por

Javier Marquez

.